안녕하세요, SDmaster입니다. 이번 포스팅은 AI가 그린 어색한 손모양들을 고쳐보는 워크플로우를 뜯어보려고합니다.

AI로 이미지를 생성하다보면 유독 손모양이 기괴하거나 어색하게 나오는 경우를 많이 겪어보셨을 거라고 생각합니다.

이 문제를 해결하기 위해 가져온 워크플로우가 오늘 소개드릴 방법입니다.

ComfyUI 인페인트(Inpaint)로 원하는 부분 수정하기

인페인팅 모델은 인페인팅을 위해 특별히 설계된 모델입니다. 모델 아키텍처가 표준 모델과 다릅니다. 아래에서 인페인팅 모델이 포함된 ComfyUI 인페인트 워크플로우를 다운로드할 수

generative-ai-everything.tistory.com

AI가 그린 이미지들을 수정하는 방법은 위 포스팅에 있는 방법 외에도 여러가지 방법이 존재합니다. 보통 원하는 이미지를 수정하는 몇가지 방법들이 있습니다.

- 이미지에 mask한 후 Inpaint로 수정

- IPAdapter로 참조 이미지를 활용한 수정

- Face Detailer, SEGS Detailer를 이용한 수정

이 외에도 다양한 방법들로 생성된 이미지를 수정할 수 있습니다. 그 중 오늘은 특히 손 모양만 특정해서 수정할 수 있는 방법에 대해 말해볼까 합니다. 오늘 사용할 특별한 node는 바로 'MeshGraphormer hand Refiner' 라는 node 입니다.

간략하게 설명하자면 이 node는 ControlNet-depth와 연동하여 손만 특정해 인식시켜 주는 node라고 보시면 됩니다.

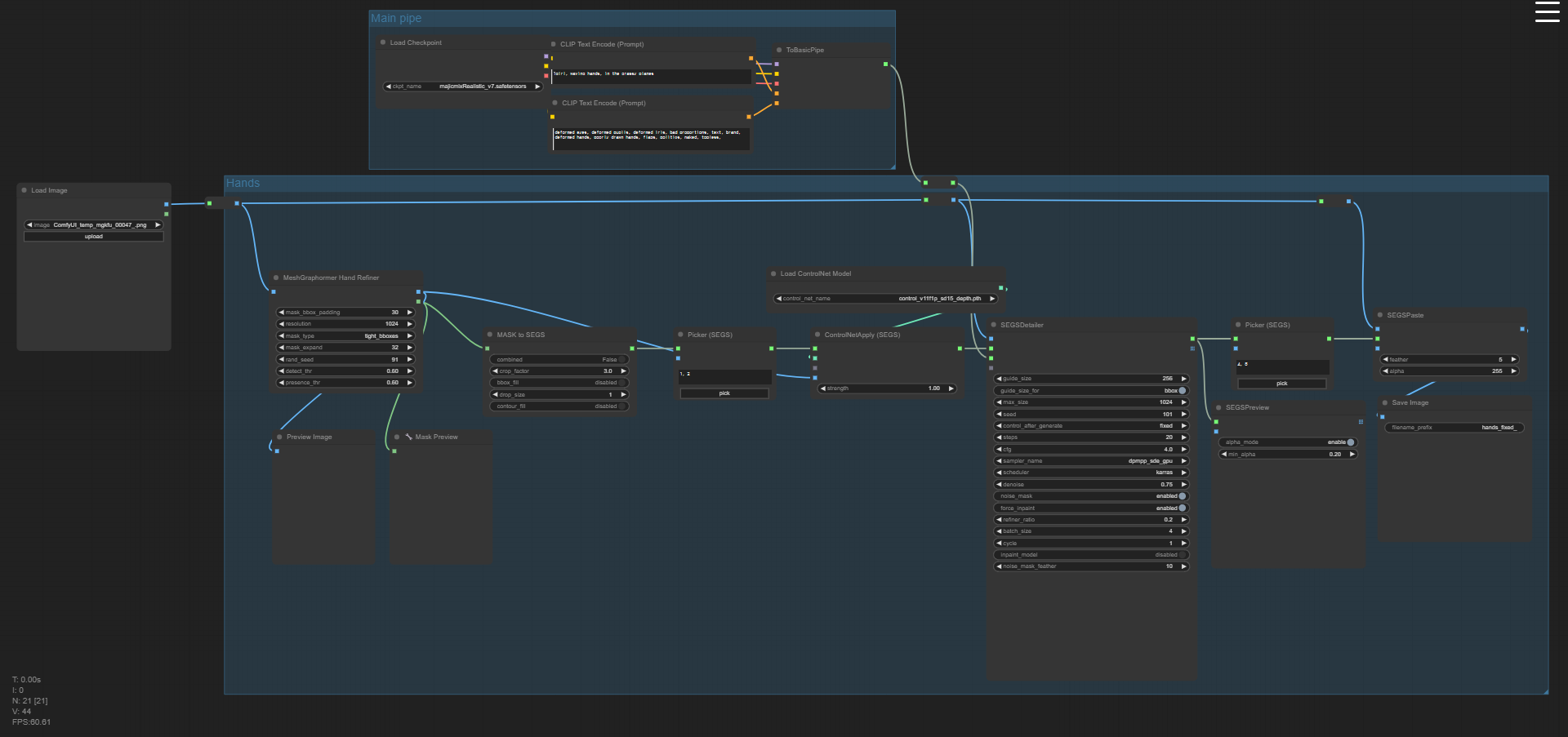

그럼 아래 전체적인 워크플로우를 먼저 보여드린 후 세세하게 뜯어보겠습니다.

워크플로우를 간략히 요약하자면 MeshGraphormer hand Refiner node로 손을 특정한 뒤 SEGSDetailer를 이용해 다시 그려 준다고 보시면 됩니다.

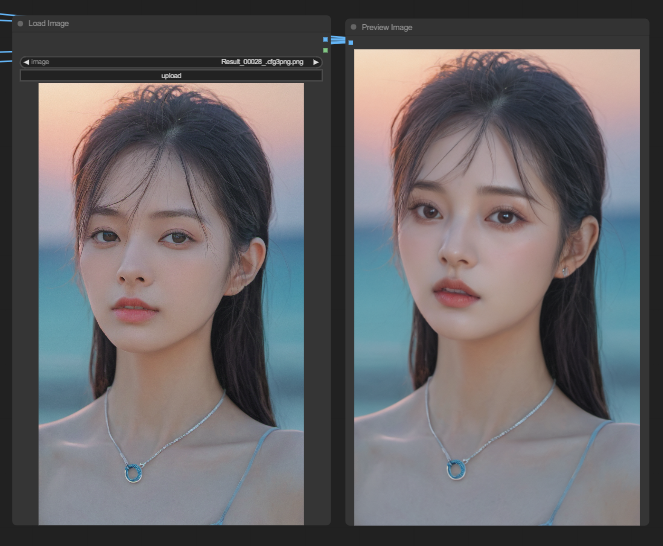

그럼 임의로 이미지 하나를 생성해보겠습니다.

역시나 손가락을 6개나 그려서 나와버렸네요. 기본적으로 스테이블 디퓨전은 손가락 갯수라는 것을 이해하지 못하기 때문에 발생하는 현상입니다.

그럼 이 이미지에서 손부분만 수정해보겠습니다.

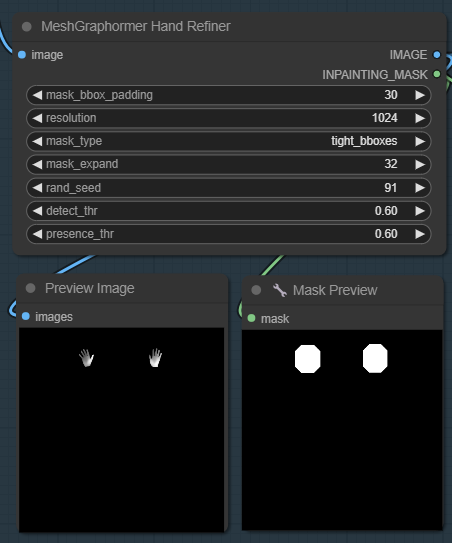

MeshGraphormer hand Refiner

Loda Image node로 수정할 이미지를 불러오고 MeshGraphormer hand Refiner node와 연결시켜 손을 인식하게 만듭니다.

기본적으로 MeshGraphormer hand Refiner node는 mask와 depth기능을 담고 있기 때문에 밑에 Preview image를 보시면 손 부분이 depth image가된걸 보실 수 있습니다.(마스크의 밝은 영역일수록 앞으로 나와 있는 부분이라고 보시면됩니다)

여기서 저희는 기존 이미지를 그대로 쓰고 손 부분만 바꾸고 싶기 때문에 mask된 이미지 써야합니다.

그리고 SGESDetailer를 이용해야하기 때문에 mask이미지를 세그먼트화 시키기 위해 Mask to SEGS node를 이용합니다.

그리고 이 세그먼트화 된 depth image를 ControlNet - depth 기능을 이용해 인식시킨 후 SGESDetailer node에 연결 시켜줍니다. (워크플로우에 있는 Picker(SEGS) node는 오류가 발생할 경우 꺼주셔도 무방합니다.)

ControlNet 모델같은 경우 SD1.5와 SDXL 모델을 구분지어서 사용해야합니다.

SD1.5 모델인 경우 : control_v11f1p_sd15_depth.safetensors

SDXL 모델인 경우 : control-lora-depth-rank256.safetensors

▶ContolNet 모델 다운 링크◀

이제 SEGSDetailer node로 손부분의 영역만 인식 시킵니다. 밑에 이미지를 보시면 여러개의 세분화된 수정 이미지가 나오는걸 확인할 수 있습니다.

(Picker(SEGS) node로 원하는 여러개의 이미지를 뽑고 그중 마음에 드는 것을 선택할 수도 있습니다)

이제 SEGSPaste node를 이용해 기존 베이스 이미지와 세그먼츠된 이미지를 합성시켜주면 최종 결과물이 나옵니다.

최종 결과물 비교

깔끔하게 손가락이 6개에서 5개로 바뀌었습니다. 사용해보시면 갯수뿐만 아니라 어색하게 뭉게진 경우, 없는 경우도 다 복원이 되는걸 확인할 수 있습니다.

※ 해당 워크플로우를 원하시는 분은 비밀 댓글로 이메일을 남겨주세요

'ComfyUI > Workflow 뜯어보기' 카테고리의 다른 글

| ComfyUI-IC-Light로 프로 사진 작가처럼 조명 입히기 (2) | 2024.06.04 |

|---|---|

| ComfyUI FreeU 기능을 이용하면 이미지 퀄리티가 달라집니다 (0) | 2024.05.29 |

| ComfyUI에서 ControlNet의 모든것(Open pose, Cany, Tile...) (0) | 2024.05.17 |

| ComfyUI Face Detailer을 이용한 얼굴 보정 워크플로우 (3) | 2024.05.15 |

| ComfyUI Face Detailer 파라미터 뜯어보기 (feat.Impact Pack) (0) | 2024.05.09 |

생성형 이미지 AI 중 스테이블 디퓨전에 관한 내용을 주로 다룹니다.

포스팅이 좋았다면 "좋아요❤️" 또는 "구독👍🏻" 해주세요!